谷歌、Facebook、亚马逊、微软、NVIDIA及BAT在深度学习方面的进展

liyonghua

2016年6月26日

下一个浪潮

评论(0)

浏览(1793)

星星之火,可以燎原

深度学习一度备受冷落,真正的燎原之势始于2012年多伦多大学Geoffrey Hinton的学生Alex Krizhesky在ILSVRC(ImageNet Large Scale Visual Recognition Challenge,ImageNet大规模视觉识别竞赛,http://image-net.org/challenges/LSVRC/)中使用深度学习方法一举夺得图像分类、目标定位两个项目冠军,远远拉开了与第二名(传统计算机视觉方法)成绩的差距。

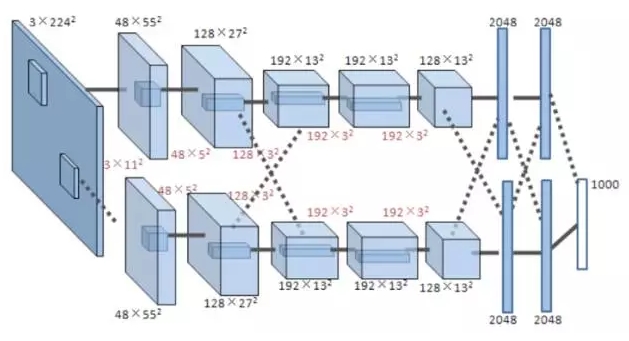

如图1-2所示为Alex在比赛中使用的深度学习模型AlexNet结构。注意到网络分成上下两部分,分别运行在两块GPU(Graphics Processing Unit)上,其中虚线表示两块GPU之间的数据通信。事实上,该模型已成为深度学习的模板结构,一些新模型(VGG/GoogLeNet)均在AlexNet基础上改进得到。

图1-2 AlexNet结构

为什么深度学习在2012年而不是其他时间爆发?主要有3个有利因素:

(1)更大的数据集,如ImageNet。

(2)新的深度学习技术,如ReLU、Dropout等技术。

(3)新的计算硬件,如GPU。

Google在Geoffrey Hinton等大牛的带领下,在理论与技术方面一直保持世界领先地位。利用GoogLeNet,在2014年ILSVRC中其分类错误率低至6.66%。

基础平台包括早期基于大规模CPU集群的DistBelief(由16000个计算节点构成)和近期开放的支持GPU加速的TensorFlow。2016年朋友圈刷屏的“阿尔法狗”(AlphaGo)也是Google 强大深度学习的具体案例之一。

Microsoft在2015年ILSVRC目标检测任务中使用深度残余学习框架(Deep Residual Learning Framework)取得绝对优势,赢得200个类目中194个最佳检出率,平均检出概率高达62%(2014年同一任务最好结果为37%)。基于Caffe实现的Fast-RCNN(作者为Ross Girshick)在目标识别领域占有重要地位。

Microsoft在基础平台方面也势头强劲,2015年推出的Azure Machine Learning Studio 有大量的机器学习算法,适合用来构建预测分析解决方案。这些算法可用于一般的机器学习,如回归分析、分类、聚类和异常检测,且每一个都可以解决不同类型的机器学习问题。为其作支撑的不仅有高可扩展性、支持CPU/GPU计算的Minerva及分布式深度学习训练系统Adam、CNTK,还有利用Catapult加速深度卷积神经网络(DCNN)的项目也在进行中。

Facebook于2013年成立了人工智能实验室,在Yann LeCun的带领下Facebook同纽约大学数据科学中心在数据科学、机器学习、人工智能领域展开合作,代表性工作有最著名的开源深度学习项目Torch(http://torch.ch/)和fbcunn(https://github.com/facebook/fbcunn)。

Amazon本身是做IaaS平台的,看到机器学习如火如荼的发展,也迅速融入并推出了云上的机器学习服务(http://aws.amazon.com/cn/machine-learning/),提供一种PaaS模式。Amazon Machine Learning提供可视化的工具和向导,无须学习复杂的机器学习算法和技术。使用简单的 API即可让用户应用程序轻松获得预测能力,而无须实现自定义预测生成码或管理任何基础设施。采用Amazon内部使用的机器学习方法,非常容易扩展。而且,使用Amazon Machine Learning不需要对硬件或软件事先投入资金,只需按使用量付费。

另外,不得不提NVIDIA,这家老牌显卡制造商也将未来方向瞄准了深度学习,于GTC 2015、2016连续发布多款面向深度学习的GPU加速器硬件(Titan X、Tesla P100)、加速库(cuDNN)和解决方案(DIGITS DevBox、DGX-1),为深度学习的普及和更大模型的支持起到推波助澜的作用。

以上为国外情况,国内情况又如何呢?

百度是国内较早开展深度学习研究的企业,于2013年年初创立了百度深度学习实验室(Institute of Deep Learning,IDL,http://idl.baidu.com/),斯坦福大学教授、Google大脑创始人Andrew Ng随后加入。IDL研究方向包括深度学习&机器学习、机器人、人机交互、3D视觉、图像识别、语音识别等,同时开展了一系列深度学习相关的创新项目,如无人机、智能自行车DuBike、自动驾驶汽车、智能眼镜BaiduEye等。

百度在深度学习计算平台基础设施建设方面一直走在国内互联网公司的前列,百度在ImageNet挑战中取得的成绩得益于其超级计算机Minwa(36个服务器节点,每个节点2个六核Xeon E5-2620和4个NVIDIA Tesla K40m GPU)。为了提高深度学习算法的计算速度,百度在GPU和CPU上做了很多优化,发表了一些深度学习算法GPU加速的论文(虽然中间有点小插曲)。经过这些工作,百度也意识到GPU、CPU在深度学习应用中的成本效率、能耗效率和目标间的差距。在充分考量各种芯片的特性后,可编程、低功耗并拥有超强并行计算能力的FPGA走进了百度工程师们的视野。百度开始尝试用FPGA打造AI专有芯片,并成就了第一版AI专有芯片版百度大脑——FPGA版百度大脑。这使得百度成为了全球最早将FPGA规模应用在人工智能领域的公司。

阿里巴巴作为电子商务巨头,很早就看到了深度学习在商品检索方面的应用价值,在阿里巴巴图像搜索的领军人物、阿里巴巴搜索事业部研究员华先胜的带领下迅速将深度学习技术成功应用到手机淘宝图像搜索业务——拍立淘中。2015年“双11”当天,上千万消费者使用了拍立淘功能,引导了数千万元的销售额。拍立淘上线一年以来,所覆盖的类目范畴已经从最开始的女装,发展到目前的男女装、鞋包、配饰、食品、数码、家居、日用百货、内衣、瓶饮等十余个类目。与通用搜索主要依靠字节不同,图像搜索被主要定义为“以图搜图”。据华先胜介绍,图像搜索的第一步是训练计算机进行图像理解,也就是通过计算机将图片中的要素,包括人像、颜色、纹理等具体特征以及深度学习产生的图像描述,转换为类似于文字的“视觉词”,编成索引之后,才能再进行第二步——图像搜索。图像搜索仍有很多未知领域有待探索。在华先胜看来,能推动图像搜索下一步突破的关键有三点:深度学习、大数据分析和大量用户使用反馈。环顾国内外,似乎只有阿里巴巴能够同时具备这三个条件。对于“拍立淘”的未来,华先胜表示,拍立淘将会拓展到更多领域,力争成为人们获取信息(包括购物、教育、娱乐、新闻、知识等)的一个快捷、有趣、有效的入口,而不仅仅是搜寻商品的入口。

阿里巴巴在基础平台建设方面起步虽晚,但发展迅速,利用装备NVIDIA Tesla GPU的高性能计算集群,不仅完美支撑拍立淘、搜索、OCR、绿网、神马语音、iDST等内部业务,还进一步在2015年10月14日云栖大会上正式宣布通过阿里云对外提供公共云上的HPC服务(https://www.aliyun.com/product/hpc),使普通用户也有机会享受高性能计算平台带来的高效性和便利性。目前越来越多的中小企业选择租用云端HPC服务器,而不是自建机房做繁杂冗长的运维工作。最新机型G4配备了双Tesla M40作为加速器,可大大提高深度学习应用的运行效率,基于Docker的快速环境部署大幅降低了客户使用深度学习框架的门槛,可谓开箱即用。

腾讯拥有海量的社交关系数据,在深度学习应用方面潜力巨大,目前主要应用为语音识别、图像识别和广告推荐。腾讯优图(BestImage,http://open.youtu.qq.com/)是腾讯旗下顶级的机器学习研发团队,专注于图像处理、模式识别、深度学习等方向,在人脸检测、五官定位、人脸识别、图像理解领域都积累了完整解决方案和领先的技术水平。

腾讯在深度学习基础平台方面经历多次升级逐步完善,在Mariana基础上针对多种应用打造出Mariana DNN、Mariana CNN、Mariana Cluster等基础框架,在微信语音识别、微信图像识别方面均已成功落地,在图文类效果广告点击率提升方面也取得初步的应用。

本文内容节选自博文视点新书《深度学习—21天实战Caffe》,作者为阿里@卜居,http://blog.csdn.net/kkk584520 。预计下月初大家可以购买到。

·END·

本文固定链接:http://www.liyonghua.com/?post=436

本文由liyonghua原创或编辑,互联分享,尊重版权,转载请以链接形式标明本文地址

本文由liyonghua原创或编辑,互联分享,尊重版权,转载请以链接形式标明本文地址

发表评论: